コーセーはこのたび、動画から個人ごとの表情特徴を分類することができる表情分析技術を開発した。これは統計数理研究所の持橋大地准教授との共同研究によるものであり、研究成果の一部は2022年6月に琉球大学で開催された第138回MPS研究会にて発表。ベストプレゼンテーション賞を受賞した。

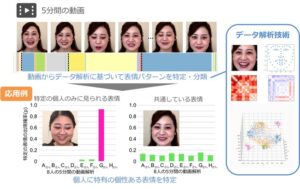

図1

近年ではSNSやビデオ会議の普及により動画を目にする機会も劇的に増えた。動画の中では人の様々な表情が積み重ねられ、個人の雰囲気や印象を左右する大切な要素の一つとなっている。しかし、これまでの表情解析技術は、表情の移り変わりが分からない静止画を分析するものや、予め「笑顔」などのラベルが決められた表情を当てはめて解析する技術がほとんどであった。そこで本当の表情を解析するため、予め決められた分類ラベルを用いずに動画中の全ての表情を特定・分類することを試みた。

はじめに、今回の表情分析を行うための情報の単位となる表情変化特徴量の設計を行った。データセットとしては、当社のビューティーコンサルタント同士のオンラインカウンセリングの研修用動画を5分間にトリミングしたものを用いた。この動画から、表情のある部分の顔の特徴点の変化量を計算することで、3分の1秒間におこる表情微分、即ち時間的な表情変化の特徴量を算出した。この表情変化特徴量は、静画にはない表情の微小な時間変化を反映することができるうえ、顔の造形や性別、年齢などの影響を受けにくく、表情だけを抽出することができる。

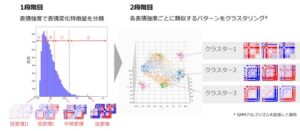

抽出した表情変化特徴量は膨大なデータである。例えば、たった一人の5分間の動画から、約900枚の表情変化特徴量が得られる。そこで、この中から、類似する表情を見つけ出してグループ化するための2段階のクラスタリング手法を開発した。1段階目は表情強度による分類であり、いわば表情変化の大きさに対応した分類である。2段階目は表情強度ごとに類似する表情変化特徴量をクラスターとしてグループ化していく工程である。例えば、強表情のクラスターの中には、満面の笑みのようなダイナミックな表情変化が含まれる。この方法により、人が認識できないようなわずかな表情変化をデータから特定し、分類することができるようになった。

開発した表情分析技術を用いて、8人の動画を対象として表情分析実験を実施。8人の表情パターンを比較することで、特定の個人だけに見られる表情と、8人全員に共通してみられる表情を抽出することができた(図1)。

今回の結果により、それぞれがもつ特有の個性ある表情とその個人が持つ魅力の関係性を紐解くための全く新しい切り口になることが期待できる。